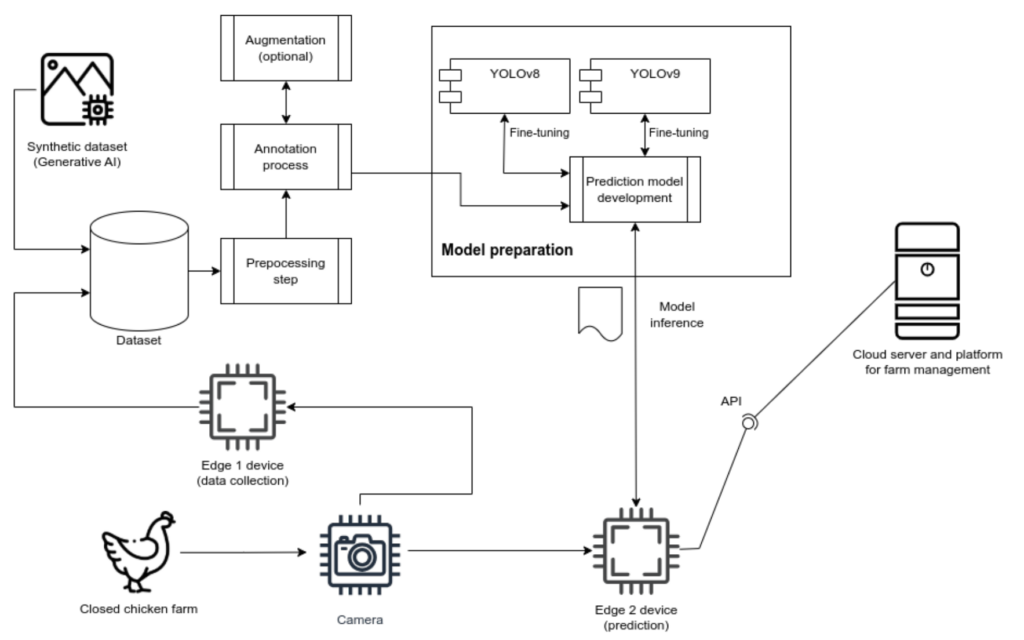

Nova naučna publikacija istraživača sa Univerziteta Donja Gorica i DunavNET-a istražuje inovativnu upotrebu generativne AI u digitalnoj poljoprivredi. Pod nazivom „Procjena sintetičkih podataka FLUX.1 na YOLOv9 za uzgoj peradi na bazi umjetne inteligencije“, studija pokazuje kako sintetički podaci, generirani korištenjem FLUX.1, mogu efikasno poboljšati modele dubokog učenja za otkrivanje pilića na pametnim farmama. Publikacija je objavljena u Journal of Applied Sciences, specijalno izdanje posvećeno primjeni kompjuterske vizije u industriji i poljoprivredi [link].

Kombinacijom stvarnih slika i slika generisanih od veštačke inteligencije i pojednostavljenih beleški sa Grounding DINO i SAM2 modelima, tim je postigao impresivnu tačnost detekcije – dokazujući da generativna veštačka inteligencija može premostiti jaz u podacima u preciznoj poljoprivredi. Ovo istraživanje dio je širih napora, uključujući i doktorsko istraživanje mr. Stevan Cakić, kao i saradnja sa kompanijom koja proizvodi platformu za pametnu poljoprivredu. Istraživanje je urađeno u kontekstu HPC4S3ME projekta, a popodržano je i kroz inicijative EuroCC Montenegro, pokazujući kako računarstvo visokih performansi i AI mogu pokrenuti održive inovacije u poljoprivredi.

ABSTRACT – This research explores the role of synthetic data in enhancing the accuracy of deep learning models for automated poultry farm management. A hybrid dataset was created by combining real images of chickens with 400 FLUX.1 [dev] generated synthetic images, aiming to reduce reliance on extensive manual data collection. The YOLOv9 model was trained on various dataset compositions to assess the impact of synthetic data on detection performance. Additionally, automated annotation techniques utilizing Grounding DINO and SAM2 streamlined dataset labeling, significantly reducing manual effort. Experimental results demonstrate that models trained on a balanced combination of real and synthetic images performed comparably to those trained on larger, augmented datasets, confirming the effectiveness of synthetic data in improving model generalization. The best-performing model trained on 300 real and 100 synthetic images achieved mAP = 0.829, while models trained on 100 real and 300 synthetic images reached mAP = 0.820, highlighting the potential of generative AI to bridge data scarcity gaps in precision poultry farming. This study demonstrates that synthetic data can enhance AI-driven poultry monitoring and reduce the importance of collecting real data.